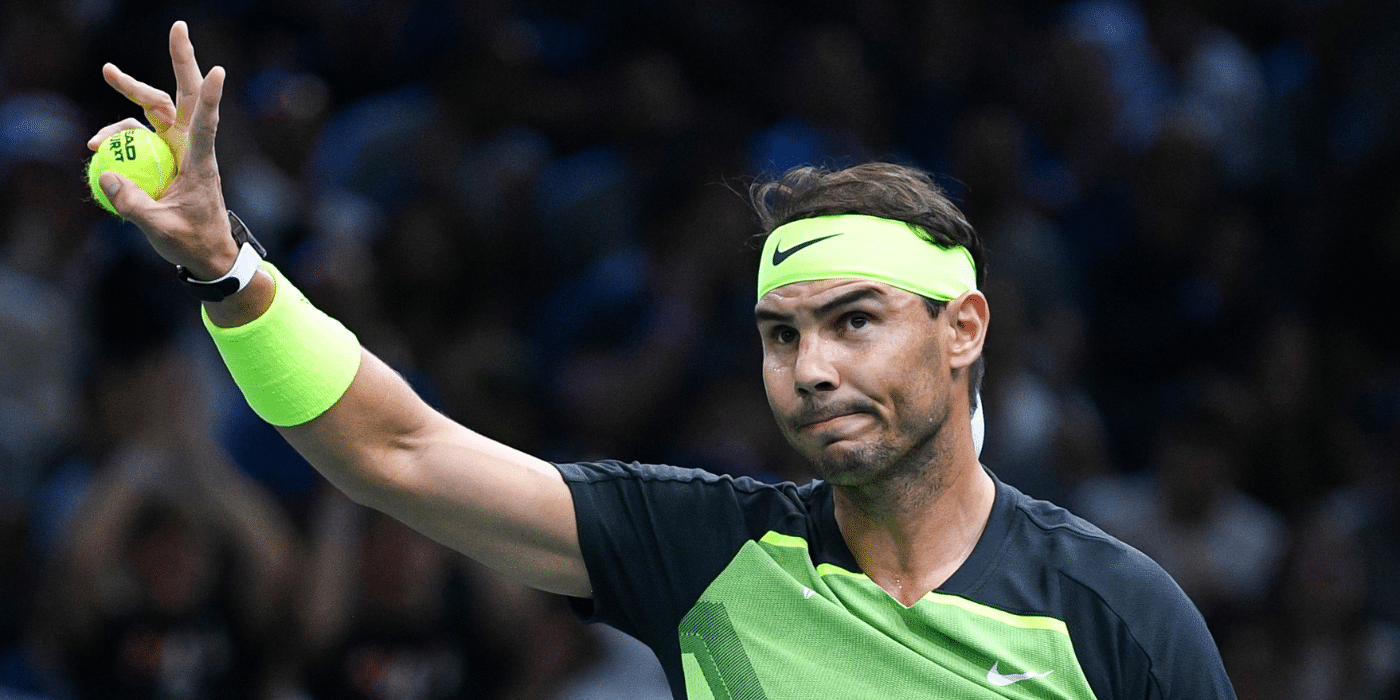

Gefälschte Finanztipps mit Nadal-Stimme: KI-Betrug wird immer dreister!

Bild: Victor Velter / shutterstock.com

Tennislegende Rafael Nadal wird Opfer von Deepfake-Videos

Rafael Nadal hat mit einem Aufschlag überrascht, der nicht vom Tennisplatz kam. Der 22-fache Grand-Slam-Sieger meldete sich auf LinkedIn – nicht mit Sport-Updates, sondern mit einer eindringlichen Warnung: Im Netz kursieren gefälschte Videos, in denen er angeblich Finanz- und Anlagetipps gibt. Das Problem: Diese Videos sind komplett künstlich erzeugt – per KI. Sowohl Nadals Stimme als auch sein Gesicht wurden mithilfe moderner Technik täuschend echt nachgeahmt.

In den Clips wirkt es, als würde Nadal persönlich Investments empfehlen. Der Eindruck ist klar: seriös, vertrauenswürdig – aber komplett gefälscht. „Diese Anlageempfehlungen und Vorschläge stammen keinesfalls von mir“, stellte der Tennisstar unmissverständlich klar.

Künstliche Intelligenz: Vom Tool zum Trickbetrug

Die Möglichkeiten von Künstlicher Intelligenz faszinieren – doch sie haben auch eine Schattenseite. Nadal spricht offen aus, was viele verdrängen: „KI ist ein Werkzeug mit enormem Potenzial, kann aber auch missbraucht werden.“ Genau das geschieht derzeit massenhaft. Personen des öffentlichen Lebens – ob Sportler, Schauspieler oder Unternehmer – werden digital kopiert, um ahnungslose Nutzer zu täuschen.

Die Masche ist perfide: Menschen vertrauen bekannten Gesichtern, besonders solchen mit einem positiven Image wie Nadal. Wenn dann ein vermeintlicher Videoausschnitt in sozialen Netzwerken auftaucht, in dem der Star einen “Geheimtipp” verrät, sind Klicks und Glauben schnell gewonnen – und das Konto des Opfers bald leer.

Warum solche Fake-Videos ein echtes Problem sind

Das Beispiel Nadal zeigt: Niemand ist mehr sicher vor Identitätsmissbrauch durch KI. Deepfake-Technologien sind inzwischen so ausgereift, dass selbst Experten oft zweimal hinschauen müssen. Die Kombination aus Bild, Stimme und glaubwürdigem Inhalt erzeugt eine Realität, die es nie gegeben hat. Für Nutzer wird es immer schwieriger, Wahrheit von Täuschung zu unterscheiden.

Besonders kritisch wird es, wenn solche Fakes genutzt werden, um Menschen finanziell zu schädigen – etwa durch betrügerische Investitionstipps oder Krypto-Scams. Die Täter agieren meist anonym, oft aus dem Ausland, rechtliche Verfolgung ist schwierig. Und die Betroffenen? Müssen zusehen, wie ihr Image missbraucht wird – mit kaum einer Handhabe.

Nadals Appell: Augen auf im digitalen Alltag

Nadal hat seine Stimme erhoben, wo viele schweigen würden. „Innovation ist immer positiv, wenn sie den Menschen dient, aber wir müssen uns ihrer Risiken bewusst sein“, sagt er. Damit setzt er ein wichtiges Zeichen: In einer Welt voller digitaler Möglichkeiten braucht es mehr kritisches Denken, mehr gesunden Menschenverstand – und vor allem eines: weniger Naivität.

Fälschungen kaum mehr zu erkennen

Dass ausgerechnet Rafael Nadal zum Gesicht eines KI-Betrugs wird, ist kein Zufall – sondern Strategie. Die Täter wissen genau, wen sie kopieren müssen, um Vertrauen zu missbrauchen. Die Technik ermöglicht das ganz einfach, das Recht hinkt hinterher. Was fehlt, ist eine klare Linie: Plattformen müssen Verantwortung übernehmen, Nutzer brauchen Schulung – und zwar nicht irgendwann, sondern jetzt. Wer heute noch denkt, „Ich würde so einen Fake schon erkennen“, der unterschätzt, wie gut Deepfakes inzwischen sind. KI ist kein Spielzeug – und das Internet kein rechtsfreier Raum.

Du willst Dich vor KI-Betrug schützen? Buche jetzt unsere Beratung und erfahre, wie Du Dich effektiv absichern kannst!